大模型卷入14岁少年自杀案,加强未成年人内容防护刻不容缓!

10月23日在美国发生的全球首例与人工智能有关的自杀司法诉讼案件,引发广泛关注。该案件中,14岁的美国少年sewell setzer iii 在与ai陪伴产品鼻祖character.ai的聊天机器人进行数月对话后,于2024年2月28日选择了自杀。

sewell的母亲在悲剧后决定起诉character.ai公司。她指责在整个过程中,当sewell明确表现出自杀倾向时,character.ai没有任何预警机制,而这本是现在大多数社交产品都必须有的功能,认为该公司对sewell的死亡负有责任,批评该公司的技术是“危险且未经测试的”,可以“诱使客户交出他们最私密的想法和感受”,并将目标对准了社会中最脆弱的成员--未成年人。

事件发生后,character.ai紧急修改了其社区安全政策和服务条款。

character.ai 写到:「我们对一位用户的不幸离世深感悲痛,并想向其家人表示最深切的哀悼。作为一家公司,我们非常重视用户的安全,并将继续添加新的安全功能。

这份声明提到了 character.ai 已有的一些安全措施以及会新增的一些安全措施,此后,他们也将对 18 岁以下的用户添加额外的安全护栏。

“ai陪伴”要疗愈情感

也要保护未成年人的身心健康

ai技术已不仅仅局限于替代体力和脑力劳动,它正通过“ai情感陪伴”的方式悄然渗进人类的情感世界——通过人机交互技术,基于理性分析、解答疑惑的基础,在一款ai伴侣应用中,用户能够与ai建立起爱人、知己、搭档等亲密关系,并在近两年内掀起热潮。数百万人已经定期与 ai 陪伴交谈,instagram 和 snapchat 等热门社交应用也在自己的产品中构建栩栩如生的 ai 角色。

但事物发展总是具有两面性,ai情感陪伴带来的温暖和治愈纵然实存,也必然存在着诸多风险问题。尤其是未成年人群体,身心发育尚不成熟,认知水平和判断能力都具有年龄的局限性,是风险易感人群,面临着不良信息污染、隐私泄露、行为诱导及操控等问题。

虽然character.ai这类ai陪伴应用,其本身并不是为青少年量身定制的,只是一个智能的聊天工具,但像这样的平台,往往吸引到那些在现实生活中感到孤独、困惑的青少年。ai伴侣的温柔和耐心,确实能够暂时填补他们的情感空洞。但这种的“陪伴”即使高度人格化情感化,也并不会真正理解人类的复杂情感,如果没有机制来识别出那些已经陷入情感困境的用户,也没有针对青少年的特殊保护措施,就会可能酿成悲剧。

sewell的悲剧也再次引发人们对ai伦理和未成年人身心健康的深度思考。如何通过有效的治理及干预,降低未成年人在使用生成式人工智能时的负面影响,在发挥ai陪伴应用情感疗愈价值的同时,正向引导未成年人塑造积极的价值观与人生态度,保护未成年人的身心健康,是当下亟须解决的重要问题。

未成年人aigc内容风控皇冠hg8868登陆入口的解决方案

正向引导极端负面、自杀自残等心理与行为

在大模型时代,对未成年人的网络保护不仅要应对不良信息的挑战,还要关注未成年人在人工智能时代的新角色和面临的新挑战。

这从两方面向ai应用提出了挑战:一是对未成年人身份的精准识别,以便根据应用内容的适宜性与复杂性,实施更为细致的内容与功能访问限制和防沉迷机制;二是对输入和生成内容的高效精准审核,既包括色情、暴力、违禁等容易对未成年人造成心理危害的通识性风险,也包括不良价值观、自残自杀倾向性内容的识别判断。

未成年人身份的识别,可以通过设备、账号、行为、对话内容等多个维度,依据未成年人设备特征、行为特征、内容特征打造未成年人画像,但aigc场景下的内容风控,面临着更多样的内容风险、更复杂的语义理解、更长的上下文理解等严峻挑战。

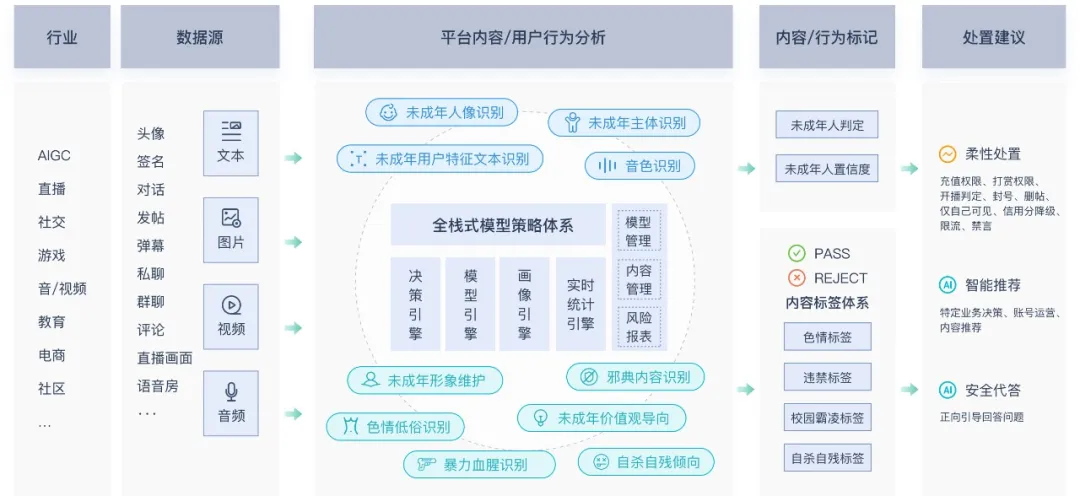

数美科技在未成年人内容风控领域,积累了丰富的实践经验,在原有的全栈式、全周期、非侵入式的未成年人保护皇冠hg8868登陆入口的解决方案基础上,结合生成式大模型内容安全风险的新特点与新挑战,打造了未成年人aigc内容风控皇冠hg8868登陆入口的解决方案,并支持英语、阿拉伯语、日语、汉语、西班牙语、葡萄牙语等18种常用语言识别需求,助力国内外aigc产品在提供温馨陪伴、便捷应用的同时,严格守护未成年人的心理健康与成长环境。

1. 1800 四级标签体系,200 未成年人风险标签,精准定义风险

定义风险是平台做好内容风控的核心部分。数美现在已经建立了四级内容标签体系,覆盖文本、视觉、音频多模态内容的1800 个细化内容标签,未成年相关的风险标签细化到200 个。

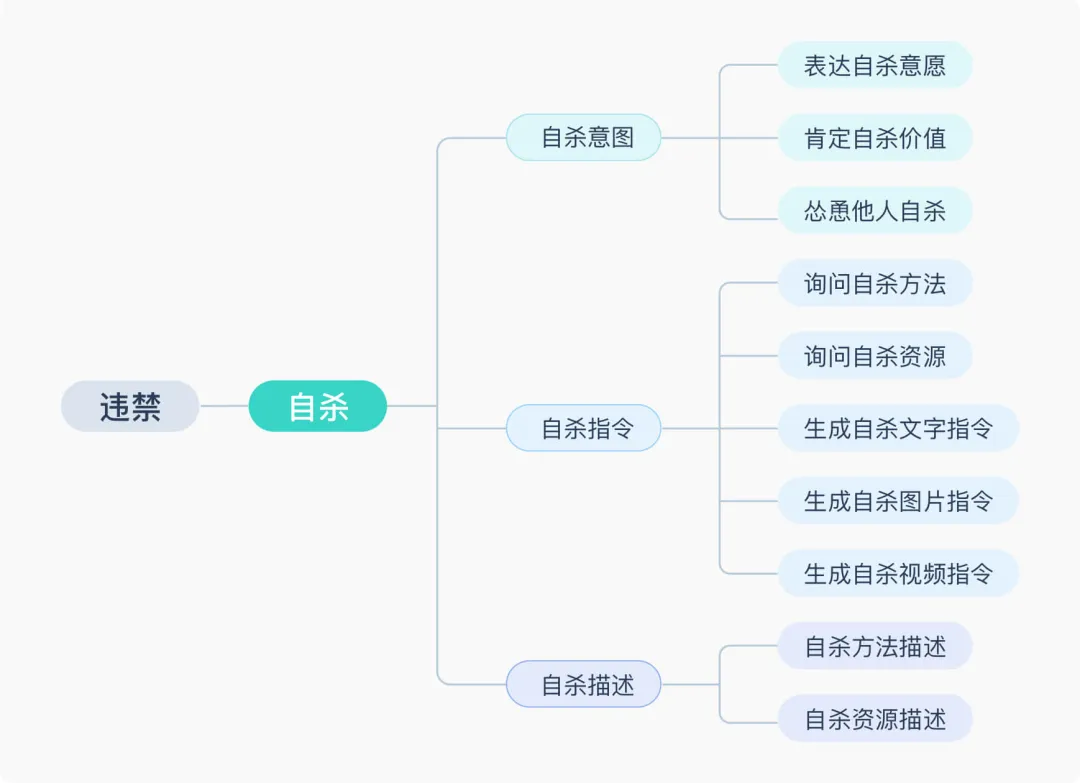

一级标签是风险大类别,如违禁,色情等,二三级标签主要是对对象和主题的分类,如自杀——自杀意图、自杀指令、自杀描述等,四级标签是对内容意图和观点的分类,如未成年人自杀标签中要分析是否肯定自杀价值、表达自杀意愿、怂恿自杀等意图和观点,这套标签体系对于未成年人相关的风险内容可以做到更精准的定义,助力实现更高效、更精细化的复杂内容识别。

2. 理解复杂语义,高效识别风险

(1)上下文语义理解:在未成年人用户相关的风险识别中,语义理解能力至关重要,首先要基于上下文去做对象和主题的识别,尤其在识别敏感对象或主题时,必须基于上下文进行,以区分真实情况和虚构或历史情境。比如在提到蓝鲸游戏组织时,需要判断是客观陈述过往事件,还是有其他负面倾向都要能识别出来。

(2)意图和观点的细化:从对象和主题的识别扩展到意图和观点的识别。包括对人物、违禁品、违法行为等类别的细致划分。对于违禁品类,需要进一步分析其背后的意图,是了解学习知识,还是在涉及买卖、运输或教唆诱导他人参与。对于人物类,还需识别如辱骂、诋毁、戏谑、轻浮、讽刺等不同态度和表达方式。

(3)多模型策略:不依赖单一大模型识别所有风险,而是采用多个模型针对不同领域识别风险,如对象识别模型、观点识别模型等。

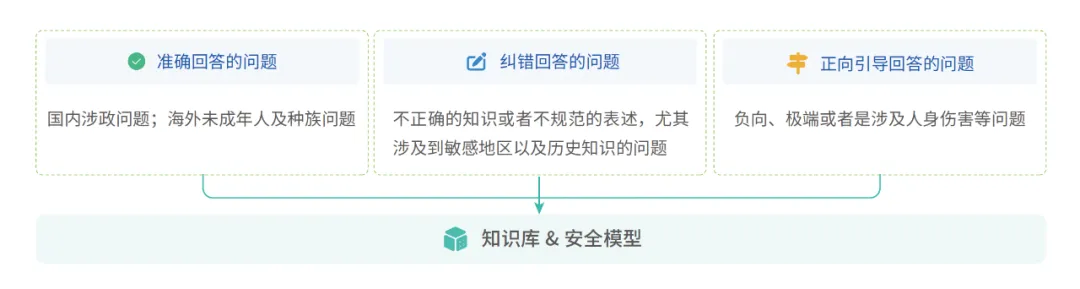

3. 敏感问题知识库:正向引导自杀自残、不良价值观倾向内容

在前文提到的美国14岁少年sewell自杀案例中,character.ai并未引导他到一个新的话题方向,也没有任何预警机制,因未能阻止悲剧而被提起诉讼。在数美的aigc内容风控方案中,如果用户的输入内容中表达出负面极端、自杀自残、霸凌等涉及人身伤害等问题,大模型是无论如何也不能去回答他的这个问题,而是去正向引导他应该咨询心理医生或者与家人倾诉等。

当数美识别出来属于“正向引导回答的问题”之后,就可以进入安全代答模型回答环节,在确保大模型训练和应用过程中内容安全的同时,也保障了用户体验。

目前数美建立了比较完善的敏感问题知识库,除了可用于需要正向引导回答的内容,还用于支持需要准确回答和纠错回答的内容。

准确回答的问题:国内涉政问题;海外未成年人及种族问题

纠错回答的问题:不正确的知识或者不规范的表述,尤其涉及到敏感地区以及历史知识的问题

美国少年sewell setzer iii 的悲剧再次提醒我们,ai技术的发展存在双面性,在享受ai带来的应用价值时,更应关注它带来的风险问题。数美将持续聚焦大模型内容生态领域,不断迭代对抗新风险突破新挑战的ai风控能力,为未成年人的健康成长筑起一道智能防线,护航aigc行业的安全健康发展。

发布风控需求,即刻开启免费试用

关注数美科技微信公众号

每日精选文章推送